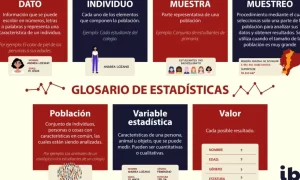

La estadística no paramétrica es un conjunto de técnicas estadísticas que no asumen distribuciones específicas para los datos analizados. A diferencia de la estadística paramétrica, que requiere que los datos sigan una distribución conocida (como la normal), la estadística no paramétrica se utiliza principalmente cuando los supuestos sobre la distribución de los datos son difíciles de cumplir o cuando se trabaja con datos ordinales o nominales.

Este tipo de estadística se convierte en una herramienta fundamental en múltiples disciplinas, ofreciendo métodos robustos para el análisis de datos sin necesidad de cumplir con requisitos estrictos. En este artículo, exploraremos en profundidad el concepto de estadística no paramétrica, sus aplicaciones y las ventajas que ofrece en comparación con su contraparte paramétrica. Te invitamos a continuar leyendo para ampliar tus conocimientos sobre esta importante área de la estadística.

Contenido

- 1 ¿Qué es la estadística no paramétrica y por qué es fundamental en el análisis de datos?

- 2 Estadística no paramétrica │Introducción

- 3 Conceptos básicos de estadística inferencial

- 4 Tipos de Pruebas No Paramétricas

- 5 Ventajas de Utilizar Estadística No Paramétrica

- 6 Aplicaciones de la Estadística No Paramétrica

- 7 Desafíos y Limitaciones de la Estadística No Paramétrica

- 8 Preguntas Frecuentes

- 8.1 ¿Qué es la estadística no paramétrica y en qué se diferencia de la estadística paramétrica?

- 8.2 ¿Cuáles son las principales características de los métodos de estadística no paramétrica?

- 8.3 ¿En qué situaciones es recomendable utilizar estadísticas no paramétricas?

- 8.4 ¿Cuáles son algunos ejemplos de pruebas no paramétricas comunes?

¿Qué es la estadística no paramétrica y por qué es fundamental en el análisis de datos?

La estadística no paramétrica se refiere a un conjunto de técnicas y métodos estadísticos que no asumen una distribución específica para los datos. A diferencia de la estadística paramétrica, que se basa en suposiciones sobre la forma de la distribución (como la normalidad), la estadística no paramétrica es más flexible y se adapta a diferentes situaciones donde esas suposiciones pueden no cumplirse. Esta característica la hace particularmente valiosa en el análisis de datos.

Fundamentos de la estadística no paramétrica:

- No requiere distribuciones específicas: Esto permite su uso en una variedad de datos, incluyendo aquellos que son ordinales o nominales.

- Robustez ante violaciones de supuestos: Este tipo de métodos es menos sensible a valores atípicos y a desviaciones de las condiciones necesarias para la estadística paramétrica.

- Aplicación en muestras pequeñas: La estadística no paramétrica es ideal cuando se tiene un tamaño de muestra reducido, donde las estimaciones de parámetros pueden ser ineficaces.

Importancia en el análisis de datos:

El uso de la estadística no paramétrica es fundamental por varias razones:

- Adecuación para datos no normales: Muchos conjuntos de datos en la práctica real no se distribuyen de manera normal. Al utilizar estadística no paramétrica, se evita la necesidad de transformar estos datos para cumplir con los supuestos de normalidad.

- Versatilidad en tipos de datos: Se puede aplicar a datos categóricos y ordinales, lo cual es especialmente útil en encuestas y estudios de opinión.

- Simplicidad en interpretaciones: Los resultados obtenidos mediante métodos no paramétricos suelen ser más fáciles de entender y comunicar, especialmente en contextos donde los conceptos estadísticos son complejos.

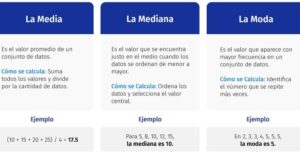

- Enfoque en la mediana y rangos: A diferencia de la media, que puede ser influenciada por valores extremos, la mediana y otros rangos utilizados en métodos no paramétricos proporcionan medidas de tendencia central más robustas.

Técnicas comunes en estadística no paramétrica:

Algunas de las principales técnicas no paramétricas incluyen:

- Prueba de Mann-Whitney: Utilizada para comparar dos grupos independientes.

- Prueba de Wilcoxon: Aplicada para comparar dos muestras relacionadas.

- Prueba de Kruskal-Wallis: Extensión de la prueba de Mann-Whitney a más de dos grupos.

- Prueba de Friedman: Utilizada para datos relacionados en más de dos tratamientos o grupos.

La estadística no paramétrica, por lo tanto, juega un papel crítico en el análisis de datos contemporáneo, permitiendo a los investigadores obtener conclusiones significativas sin las limitaciones impuestas por los supuestos de modelos paramétricos. Su aplicación se extiende a diversas disciplinas, desde la psicología hasta la biología, donde la flexibilidad y adaptabilidad son cruciales para el análisis correcto de los datos.

Estadística no paramétrica │Introducción

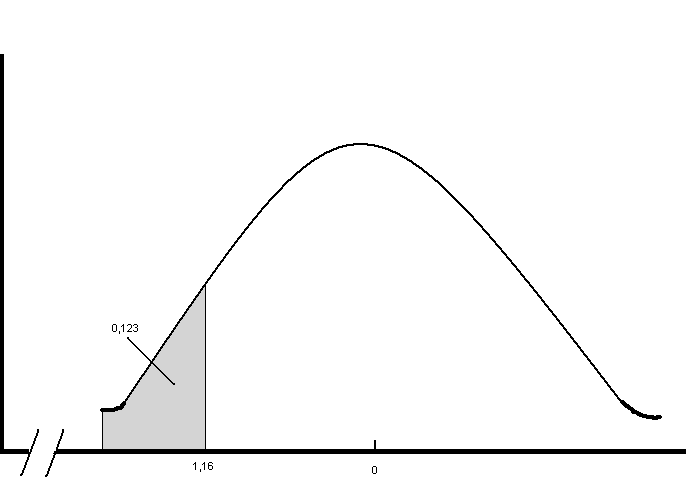

Conceptos básicos de estadística inferencial

Tipos de Pruebas No Paramétricas

Pruebas de Comparación de Medias

Las pruebas de comparación de medias son esenciales en el ámbito de la estadística no paramétrica, ya que permiten evaluar si existen diferencias significativas entre dos o más grupos. Ejemplos comunes incluyen la prueba de Mann-Whitney y la prueba de Kruskal-Wallis. Estas pruebas se utilizan cuando los datos no cumplen con los supuestos necesarios para aplicar las pruebas paramétricas, como la normalidad de los residuos.

La prueba de Mann-Whitney, por ejemplo, es especialmente útil para comparar dos grupos independientes, mientras que la prueba de Kruskal-Wallis extiende esta comparación a tres o más grupos. Ambas pruebas se basan en ranks (posiciones) en lugar de los valores absolutos, lo que las hace más robustas frente a valores atípicos y distribuciones sesgadas.

Adicionalmente, estas pruebas son un recurso valioso en estudios donde se recogen datos ordinales o cuando la escala de medición no permite asumir una distribución normal. La interpretación de los resultados se realiza generalmente mediante la evaluación de los rangos medios de cada grupo y la identificación de diferencias estadísticamente significativas.

Pruebas de Correlación No Paramétricas

La correlación no paramétrica es otro aspecto fundamental de la estadística no paramétrica, que se utiliza para evaluar relaciones entre variables sin asumir una distribución normal. Pruebas como el coeficiente de correlación de Spearman y el coeficiente de Kendall son ampliamente utilizadas en este contexto.

El coeficiente de correlación de Spearman mide la fuerza y dirección de la asociación entre dos variables ordinales. A diferencia de su contraparte paramétrica, que asume que la relación es lineal, Spearman permite evaluar relaciones monotónicas, lo cual es relevante en muchas aplicaciones prácticas, especialmente en ciencias sociales y biológicas.

Por otro lado, el coeficiente de Kendall tiene un enfoque similar pero se basa en la concordancia de pares de observaciones, lo que lo hace menos sensible a discrepancias en los rangos. Estas herramientas son cruciales para investigaciones donde la relación entre variables no es fácilmente modelable mediante métodos paramétricos.

Ventajas de Utilizar Estadística No Paramétrica

Flexibilidad en el Análisis de Datos

Una de las principales ventajas de la estadística no paramétrica es su flexibilidad al trabajar con diferentes tipos de datos. Esto es especialmente relevante en contextos donde se encuentran dificultades para cumplir los supuestos necesarios de normalidad y homogeneidad de varianzas, características fundamentales en muchos análisis paramétricos.

Este enfoque es particularmente útil en estudios exploratorios y en situaciones donde el tamaño de la muestra es pequeño. Al no depender de parámetros específicos, los investigadores pueden realizar inferencias más rápidas y efectivas sin la necesidad de transformaciones complejas de los datos.

Además, la estadística no paramétrica permite analizar datos ordinales y nominales, ampliando considerablemente el rango de aplicaciones posibles. Esto se traduce en una mayor capacidad para abordar preguntas de investigación en diversas disciplinas, desde las ciencias sociales hasta la biología.

Resistencia a Valores Atípicos

Otra ventaja notable de la estadística no paramétrica es su resistencia a valores atípicos. Los métodos paramétricos son susceptibles a influencias desproporcionadas de estos valores, lo que puede distorsionar los resultados y generar conclusiones erróneas. En contraste, las técnicas no paramétricas, al basarse en rangos en lugar de valores absolutos, son menos afectadas por estos casos extremos.

Esto implica que los investigadores pueden obtener resultados más representativos de la tendencia central real de sus datos, lo que fortalece la validez de sus conclusiones. Por ejemplo, en un análisis de una variable que incluye ingresos, la presencia de individuos con altos ingresos puede desviar la media, pero no afectará significativamente el análisis de rangos.

La capacidad de manejar datos contaminados es fundamental en investigaciones del mundo real, donde los datos raramente cumplen con todos los supuestos ideales. La estadística no paramétrica proporciona una alternativa sólida, permitiendo a los investigadores generar hallazgos válidos y aplicables en contextos prácticos.

Aplicaciones de la Estadística No Paramétrica

Investigaciones en Ciencias Sociales

La estadística no paramétrica se ha convertido en una herramienta invaluable en el ámbito de las ciencias sociales, donde los datos frecuentemente son ordinales o categóricos. Por ejemplo, encuestas de satisfacción o evaluaciones de calidad suelen utilizar escalas Likert, que son inherentemente ordinales. En estos casos, las pruebas no paramétricas, como la prueba de Wilcoxon, ofrecen métodos apropiados para analizar los resultados.

Estos métodos permiten a los investigadores establecer conexiones significativas entre variables sin sacrificar la precisión o validez de sus conclusiones. En estudios de comportamiento, donde las preferencias o actitudes son medidas en escalas ordinales, la estadística no paramétrica permite investigar diferencias entre grupos y asociaciones de manera efectiva.

Esta utilidad se extiende también a la segmentación de mercados y análisis demográficos, donde se busca entender cómo diferentes grupos interactúan con productos o servicios en base a sus características y percepciones, permitiendo decisiones informadas en marketing y políticas públicas.

Evaluaciones en Ciencias de la Salud

En el campo de las ciencias de la salud, la estadística no paramétrica es ampliamente utilizada para evaluar intervenciones y tratamientos donde los datos pueden no seguir distribuciones normales. Por ejemplo, estudios clínicos que analizan la eficacia de un nuevo medicamento pueden involucrar medidas de respuesta que no son lineales ni simétricas.

Las pruebas no paramétricas son particularmente útiles en ensayos clínicos y estudios epidemiológicos, ya que pueden manejar diseños experimentales complejos y datos que no se adaptan bien a modelos paramétricos convencionales. Esto incluye la evaluación de diferencias en la eficacia del tratamiento entre grupos de pacientes con características muy variadas.

Asimismo, esta metodología permite la evaluación de resultados de salud que son ordinales, como escalas de dolor o niveles de funcionalidad, proporcionando un marco adecuado para interpretar los resultados de forma que reflejen la realidad clínica.

Desafíos y Limitaciones de la Estadística No Paramétrica

Dificultades en la Interpretación

Aunque la estadística no paramétrica presenta múltiples ventajas, también enfrenta desafíos en la interpretación de resultados. La utilización de rangos en vez de valores reales puede dificultar la comunicación de hallazgos, especialmente para audiencias que no están familiarizadas con estos métodos. Esto puede llevar a malentendidos sobre la magnitud y la dirección de los efectos observados.

Además, dado que muchas pruebas no paramétricas no proporcionan estimaciones precisas de parámetros poblacionales, los investigadores a menudo deben ser cautelosos al hacer generalizaciones a partir de muestras pequeñas o en contextos donde los datos pueden no ser representativos de la población general.

Es fundamental que los investigadores que emplean estadística no paramétrica sean claros y transparentes en la forma en que presentan sus resultados, estableciendo expectativas adecuadas sobre la naturaleza de sus hallazgos y la aplicabilidad de los mismos en contextos más amplios.

Limitaciones en el Poder Estadístico

Uno de los desafíos más significativos de las pruebas no paramétricas es su poder estadístico inferior en comparación con sus homólogas paramétricas. En general, las pruebas paramétricas son más potentes porque utilizan toda la información disponible de los datos, mientras que las pruebas no paramétricas pueden perder información al centrarse únicamente en rangos.

Esto puede traducirse en la necesidad de tamaños de muestra más grandes para alcanzar la misma potencia estadística en estudios no paramétricos, lo que puede ser una limitación en investigaciones donde la recolección de datos es costosa o difícil.

A pesar de estos desafíos, es importante señalar que las pruebas no paramétricas siguen siendo un recurso valioso, especialmente cuando los supuestos de normalidad son cuestionables. La elección entre métodos paramétricos y no paramétricos debe basarse cuidadosamente en la naturaleza de los datos y los objetivos de la investigación.

Preguntas Frecuentes

¿Qué es la estadística no paramétrica y en qué se diferencia de la estadística paramétrica?

La estadística no paramétrica es un conjunto de métodos estadísticos que no asumen que los datos siguen una distribución específica, permitiendo así su aplicación en situaciones donde se desconoce la forma de la distribución. A diferencia de la estadística paramétrica, que requiere supuestos sobre la distribución (como la normalidad), la estadística no paramétrica es más flexible y se utiliza comúnmente con datos ordinales o en muestras pequeñas.

¿Cuáles son las principales características de los métodos de estadística no paramétrica?

Los métodos de estadística no paramétrica se caracterizan por no requerir suposiciones sobre la distribución de la población de donde provienen los datos. Sus principales características son:

1. Menor restricción: No asumen que los datos sigan una distribución específica, como la normal.

2. Escalas de medición: Pueden utilizarse con datos de escala ordinal o nominal, además de intervalos y razones.

3. Robustez: Son menos sensibles a valores atípicos y pueden ser más adecuados para muestras pequeñas.

4. Pruebas de hipótesis: Utilizan rangos o conteos en lugar de medias y varianza, facilitando el análisis en situaciones donde los datos no cumplen los supuestos paramétricos.

En resumen, los métodos no paramétricos ofrecen herramientas flexibles y robustas para el análisis de datos sin restricciones estrictas sobre su distribución.

¿En qué situaciones es recomendable utilizar estadísticas no paramétricas?

Las estadísticas no paramétricas son recomendables en situaciones donde los datos no cumplen con los supuestos de las pruebas paramétricas, como la normalidad y la homogeneidad de varianzas. También son útiles cuando se trabaja con pequeñas muestras, datos ordinales o categorías, y en caso de que existan valores atípicos que puedan influir en los resultados.

¿Cuáles son algunos ejemplos de pruebas no paramétricas comunes?

Algunos ejemplos de pruebas no paramétricas comunes son:

1. Prueba de Wilcoxon: utilizada para comparar dos grupos relacionados.

2. Prueba de Kruskal-Wallis: usada para comparar tres o más grupos independientes.

3. Prueba de Friedman: aplicación en datos relacionados o repetidos.

4. Prueba de Mann-Whitney: para comparar dos grupos independientes.

Estas pruebas se emplean cuando los datos no cumplen con los supuestos necesarios para pruebas paramétricas, como la normalidad y homogeneidad de varianzas.

En conclusión, la estadística no paramétrica constituye una herramienta fundamental para el análisis de datos que no se ajustan a supuestos paramétricos. Su versatilidad y aplicabilidad en diversas disciplinas la hacen indispensable. Te invitamos a compartir este contenido y a seguir explorando más sobre estadísticas y sus conceptos relacionados.