El concepto de estadística paramétrica se refiere a un conjunto de técnicas estadísticas que asumen que los datos siguen una distribución específica, generalmente la normal. Estas técnicas son fundamentales en el análisis de datos, ya que permiten realizar inferencias sobre la población a partir de muestras, facilitando la comparación y predicción de fenómenos.

La estadística paramétrica se fundamenta en ciertos parámetros, como la media y la desviación estándar, que caracterizan la distribución de los datos. Al utilizar métodos como la prueba t de Student o el análisis de varianza (ANOVA), se pueden obtener resultados más precisos y significativos, siempre que se cumplan las premisas necesarias para su aplicación.

Si deseas profundizar en este tema y comprender mejor sus implicancias y aplicaciones, te invitamos a continuar leyendo el artículo.

Contenido

- 1 Entendiendo la Estadística Paramétrica: Definición, Características y Aplicaciones

- 2 Ejemplo práctico de Parámetro y Estadístico

- 3 Que es la estadistica no parametrica

- 4 Fundamentos de la estadística paramétrica

- 5 Aplicaciones en la investigación científica

- 6 Limitaciones de la estadística paramétrica

- 7 Importancia del uso adecuado

- 8 Preguntas Frecuentes

- 8.1 ¿Qué es la estadística paramétrica y en qué se diferencia de la estadística no paramétrica?

- 8.2 ¿Cuáles son los supuestos básicos que deben cumplirse para aplicar métodos estadísticos paramétricos?

- 8.3 ¿Qué tipos de pruebas estadísticas son consideradas paramétricas?

- 8.4 ¿En qué situaciones es recomendable utilizar la estadística paramétrica?

Entendiendo la Estadística Paramétrica: Definición, Características y Aplicaciones

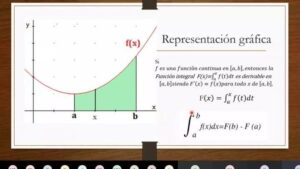

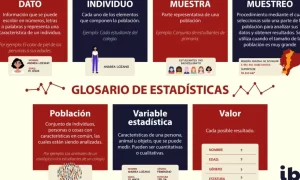

La estadística paramétrica es un conjunto de métodos estadísticos que se basan en suposiciones sobre la distribución de la población de donde se extraen las muestras. Esta rama de la estadística permite realizar inferencias sobre parámetros poblacionales a partir de datos muestrales. A continuación, se presentan algunas características y aplicaciones clave de la estadística paramétrica.

Definición: La estadística paramétrica se refiere a técnicas que asumen que los datos provienen de una población con una distribución específica, comúnmente normal. Este enfoque es fundamental para estimar propiedades de la población, como medias, varianzas y proporciones.

Características: Las principales características de la estadística paramétrica son:

- Suposiciones sobre la Distribución: Se basa en que los datos siguen una distribución conocida (normal, t de Student, etc.).

- Uso de Parámetros: Se enfoca en estimar y probar hipótesis sobre parámetros poblacionales.

- Menor Tamaño de Muestra Requerido: Generalmente, requiere un tamaño de muestra menor en comparación con la estadística no paramétrica para llegar a conclusiones firmes.

- Eficiencia: Ofrece estimaciones más eficientes si las suposiciones son correctas.

- Pruebas de Hipótesis: Utiliza pruebas como t de Student, ANOVA y regresión lineal, que son adecuadas bajo el supuesto de normalidad.

Aplicaciones: La estadística paramétrica tiene una amplia gama de aplicaciones en diversos campos, incluyendo:

- Ciencias Sociales: Para analizar encuestas y estudios de opinión, permitiendo hacer inferencias sobre tendencias en la población.

- Investigación Médica: En ensayos clínicos, se utiliza para comparar tratamientos y evaluar su efectividad basado en resultados muestrales.

- Economía: Se aplica en el análisis de datos económicos, como ingresos y gastos, para modelar comportamientos y realizar predicciones.

- Psicología: Facilita el análisis de pruebas estandarizadas y la evaluación de tratamientos psicológicos a través de modelos estadísticos.

- Ingeniería: Utilizada en el control de calidad y en la evaluación de productos a partir de muestras de datos, asegurando estándares en manufactura.

El uso de métodos paramétricos es crucial en situaciones en las que se cumplen las condiciones necesarias. Sin embargo, es importante tener en cuenta que si las suposiciones sobre la distribución son incorrectas, los resultados obtenidos pueden ser engañosos. Por esta razón, en ocasiones se deben utilizar métodos no paramétricos que no requieren estas suposiciones, especialmente cuando los datos no se ajustan a las distribuciones asumidas. El desarrollo correcto de un análisis estadístico, por lo tanto, incluye la evaluación de la adecuación de los métodos paramétricos a los datos disponibles.

Ejemplo práctico de Parámetro y Estadístico

Que es la estadistica no parametrica

Fundamentos de la estadística paramétrica

La estadística paramétrica se basa en ciertas asunciones sobre la distribución de los datos. En términos generales, se fundamenta en que los datos provienen de una población con unas características definidas, como la normalidad en la distribución. Esto significa que para aplicar pruebas estadísticas paramétricas, es crucial verificar si los datos cumplen con estas condiciones iniciales.

Suposiciones de la estadística paramétrica

Las suposiciones más comunes de la estadística paramétrica incluyen:

- Normalidad: Los datos deben seguir una distribución normal, lo cual puede ser evaluado mediante pruebas como la de Shapiro-Wilk.

- Homogeneidad de varianzas: Las varianzas de los diferentes grupos o muestras deben ser aproximadamente iguales, lo que se puede comprobar a través de pruebas como Levene.

- Independencia de observaciones: Cada observación debe ser independiente de las demás, asegurando que no haya correlación entre ellas.

Cumplir con estas suposiciones es fundamental para garantizar la validez y la confiabilidad de los resultados obtenidos a través de métodos paramétricos. Cuando alguna de estas condiciones se rompe, los resultados pueden ser engañosos y no generalizables.

Tipos de pruebas estadísticas paramétricas

Las pruebas estadísticas que forman parte de la estadística paramétrica incluyen, pero no se limitan a:

- Prueba t de Student: Utilizada para comparar las medias de dos grupos independientes.

- ANOVA (Análisis de varianza): Empleada para comparar las medias entre tres o más grupos.

- Regresión lineal: Analiza la relación entre una variable dependiente y una o más variables independientes.

Cada una de estas pruebas tiene aplicabilidades específicas y proporciona herramientas valiosas para el análisis de datos en diferentes contextos, siempre que se respeten las suposiciones mencionadas anteriormente.

Aplicaciones en la investigación científica

La estadística paramétrica tiene un papel fundamental en el ámbito de la investigación científica. Su capacidad para realizar inferencias precisas hace que sea la elección preferida en muchos estudios.

En las ciencias sociales, la estadística paramétrica es utilizada frecuentemente para analizar encuestas y estudios de caso. Por ejemplo:

- Pruebas de hipótesis: Permiten a los investigadores evaluar si hay diferencias significativas entre grupos, como en estudios de comportamiento.

- Modelos de regresión: Ayudan a entender factores que afectan diferentes variables sociales, como la relación entre ingresos y grado de educación.

Gracias a estas herramientas, los sociólogos, psicólogos y otros científicos sociales pueden formular teorías basadas en evidencia empírica, contribuyendo al avance del conocimiento en sus disciplinas.

Salud y medicina

En el campo de la salud y la medicina, la estadística paramétrica se utiliza para evaluar la efectividad de tratamientos y procedimientos médicos. A continuación se indican algunas aplicaciones:

- Ensayos clínicos: Utilizan la prueba t y ANOVA para comparar la eficacia de nuevos medicamentos frente a tratamientos estándar.

- Estudios epidemiológicos: Emplean modelos de regresión para analizar factores que impactan la salud pública y la incidencia de enfermedades.

Estas aplicaciones son cruciales para la toma de decisiones informadas en políticas de salud y para el desarrollo de nuevas estrategias terapéuticas.

Limitaciones de la estadística paramétrica

Aunque la estadística paramétrica ofrece numerosas ventajas, también presenta limitaciones que deben ser consideradas.

Ruptura de supuestos

Una de las principales limitaciones de la estadística paramétrica es la ruptura de sus supuestos fundamentales. Si los datos no son normales o no cumplen con la homogeneidad de varianzas, los resultados pueden ser inexactos. Esto puede ocurrir en diversas situaciones, como en muestras pequeñas o en datos que presentan asimetrías.

Alternativas no paramétricas

Cuando los supuestos de la estadística paramétrica no se satisfacen, los investigadores pueden recurrir a métodos no paramétricos. Estos métodos no requieren que los datos sigan una distribución específica y son útiles en diversas situaciones:

- Pruebas de Wilcoxon: Alternativa a la prueba t para datos no normalmente distribuidos.

- Prueba de Kruskal-Wallis: Opción no paramétrica para comparar múltiples grupos cuando no se cumple el ANOVA clásico.

Las alternativas no paramétricas permiten a los investigadores llevar a cabo análisis significativos y obtener conclusiones válidas, aun cuando los requisitos de la estadística paramétrica no se cumplen.

Importancia del uso adecuado

Finalmente, es fundamental poner énfasis en la importancia del uso adecuado de la estadística paramétrica en el análisis de datos.

Mejor toma de decisiones

El uso correcto de métodos paramétricos puede ayudar a los investigadores y profesionales a tomar decisiones fundamentadas, basadas en análisis rigurosos y resultados fiables. Al respetar los supuestos y aplicar correctamente las pruebas, se maximiza la validez y utilidad de los resultados obtenidos.

Educación y capacitación

Es crucial que quienes trabajan con datos estadísticos reciban la formación adecuada en estadística paramétrica. Esto incluye:

- Comprensión de supuestos: Los analistas deben ser capaces de identificar cuándo es apropiado usar métodos paramétricos.

- Interpretación de resultados: Una correcta interpretación permite unos hallazgos más pertinentes y aplicables en la práctica.

La educación sobre la estadística paramétrica es vital no solo en el ámbito académico, sino también en diversas industrias que dependen de datos precisos para guiar sus estrategias.

Preguntas Frecuentes

¿Qué es la estadística paramétrica y en qué se diferencia de la estadística no paramétrica?

La estadística paramétrica se basa en suposiciones sobre la distribución de los datos, como que siguen una distribución normal. Utiliza parámetros como la media y la varianza para realizar inferencias. Por otro lado, la estadística no paramétrica no requiere estas suposiciones y se aplica a datos que no necesariamente siguen una distribución específica. En resumen, la principal diferencia es que la estadística paramétrica asume una forma específica de la distribución de los datos, mientras que la no paramétrica no lo hace.

¿Cuáles son los supuestos básicos que deben cumplirse para aplicar métodos estadísticos paramétricos?

Para aplicar métodos estadísticos paramétricos, deben cumplirse los siguientes supuestos básicos:

1. Normalidad: Los datos deben seguir una distribución normal.

2. Independencia: Las observaciones deben ser independientes entre sí.

3. Homoscedasticidad: La varianza de los errores debe ser constante a lo largo de todos los niveles de las variables.

4. Intervalo o razón: Las variables deben ser medidas en escalas de intervalo o de razón.

Cumplir con estos supuestos asegura la validez de las inferencias realizadas a partir de los análisis estadísticos.

¿Qué tipos de pruebas estadísticas son consideradas paramétricas?

Las pruebas estadísticas paramétricas son aquellas que asumen que los datos siguen una distribución específica, generalmente la distribución normal. Algunos ejemplos de estas pruebas son:

- Prueba t de Student

- Análisis de varianza (ANOVA)

- Regresión lineal

Estas pruebas son útiles para inferir y hacer comparaciones entre medias de poblaciones.

¿En qué situaciones es recomendable utilizar la estadística paramétrica?

La estadística paramétrica es recomendable utilizarla en situaciones donde los datos cumplen con ciertos supuestos, como la normalidad de la distribución, la homogeneidad de varianzas y el nivel de medición se basa en escalas al menos intervalos. Esto incluye, por ejemplo, análisis de varianza (ANOVA) o pruebas t para comparar medias entre grupos.

En conclusión, la estadística paramétrica se establece como una herramienta fundamental en el análisis de datos, permitiendo inferencias más precisas bajo supuestos específicos. Te invitamos a compartir este contenido y a seguir explorando más sobre conceptos estadísticos para profundizar tu comprensión. ¡Sigue leyendo!